Ein Video zeigt einen Politiker, der Dinge sagt, die er nie gesagt hat. Ein Foto zeigt eine Berühmtheit in einer kompromittierenden Situation, die nie stattgefunden hat. Ein Sprachanruf klingt exakt wie dein bester Freund – ist aber komplett gefälscht. Willkommen im Zeitalter der Deepfakes. Was noch vor wenigen Jahren wie Science-Fiction klang, ist heute Realität – und die Technologie wird von Tag zu Tag besser.

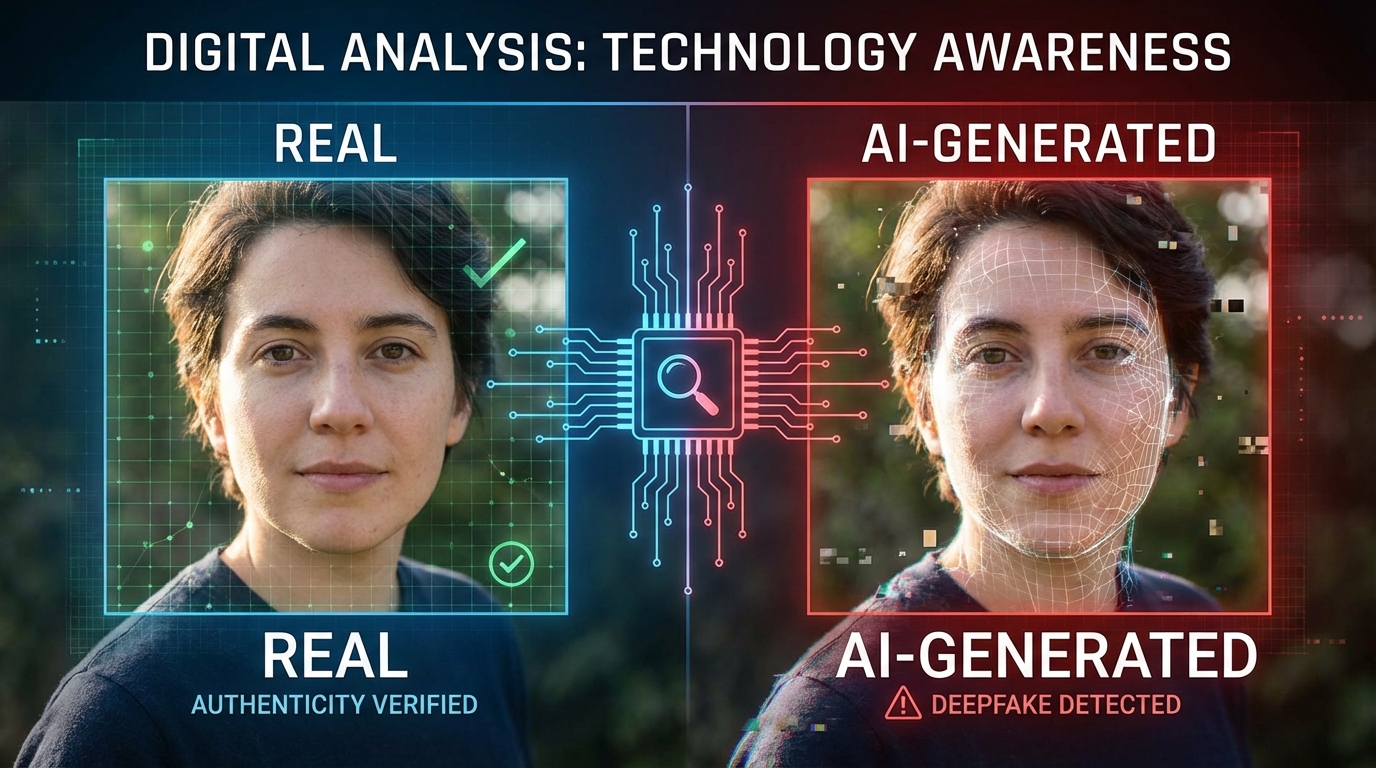

KI-generierte Fälschungen werden immer realistischer. Was vor wenigen Jahren noch leicht zu erkennen war – verzerrte Gesichter, unscharfe Ränder, merkwürdige Artefakte – ist heute selbst für Experten eine Herausforderung. Für Jugendliche, die mit diesen Technologien aufwachsen und täglich mit Bildern und Videos konfrontiert sind, ist es essenziell, Fälschungen erkennen zu können. Medienkompetenz ist im Zeitalter der KI keine optionale Zusatzqualifikation mehr – sie ist eine Grundkompetenz wie Lesen und Schreiben.

- Deepfakes sind KI-generierte Videos, Bilder oder Stimmen, die reale Personen täuschend echt imitieren

- Die Technologie wird exponentiell besser – Erkennung wird zunehmend schwieriger

- Deepfakes werden für Desinformation, Betrug, Mobbing und nicht-einvernehmliche Pornografie missbraucht

- Achte auf unnatürliche Gesichtsbewegungen, Beleuchtungsfehler, Artefakte und zu perfekte Symmetrie

- Google Rückwärtssuche, InVID und SynthID sind Tools zur Überprüfung

- In Österreich sind Deepfakes über bestehende Gesetze wie das Cybermobbing-Gesetz strafbar

Was sind Deepfakes – und woher kommt der Begriff?

Der Begriff „Deepfake“ setzt sich aus „Deep Learning“ (einer KI-Technik, bei der neuronale Netzwerke aus großen Datenmengen lernen) und „Fake“ zusammen. Deepfakes nutzen künstliche neuronale Netzwerke, um Gesichter in Videos auszutauschen, Stimmen zu imitieren oder komplett neue Bilder von Personen zu generieren, die täuschend echt aussehen.

Die Technologie basiert auf sogenannten GANs (Generative Adversarial Networks) – zwei KI-Systeme, die gegeneinander arbeiten. Das eine erzeugt Fälschungen, das andere versucht sie zu erkennen. Durch dieses „Wettrennen“ werden die Fälschungen immer besser. Neuere Modelle wie Diffusions-Modelle (die Grundlage von Tools wie Midjourney oder DALL-E) haben die Qualität nochmals drastisch verbessert.

Der Begriff tauchte erstmals 2017 auf Reddit auf, als ein User unter dem Pseudonym „deepfakes“ gefälschte Promi-Videos veröffentlichte. Seitdem hat sich die Technologie rasant weiterentwickelt – von grob erkennbaren Fälschungen zu nahezu perfekten Imitationen.

Arten von Deepfakes

Die Welt der KI-generierten Fälschungen ist vielfältig. Es gibt verschiedene Techniken und Einsatzbereiche:

- Face Swap: Das Gesicht einer Person wird in einem Video durch das einer anderen ersetzt. Die KI analysiert die Gesichtszüge, Mimik und Beleuchtung und passt das neue Gesicht entsprechend an. Frühe Versionen waren leicht zu erkennen, moderne Face Swaps sind erschreckend überzeugend.

- Face Reenactment: Die Mimik und Mundbewegungen einer Person werden so manipuliert, dass sie etwas „sagt“, das sie nie gesagt hat. Ein realer Mensch „steuert“ dabei die Gesichtsbewegungen der Zielperson. Besonders gefährlich für die Manipulation politischer Aussagen.

- Voice Cloning: Die Stimme einer Person wird geklont und kann beliebige Texte „sprechen“. Bereits wenige Sekunden Originalton reichen modernen Systemen aus, um eine überzeugende Stimmkopie zu erstellen. Die Qualität ist mittlerweile so hoch, dass selbst Familienmitglieder die Fälschung nicht erkennen.

- KI-generierte Bilder: Tools wie Midjourney, DALL-E 3 oder Stable Diffusion erzeugen fotorealistische Bilder von Personen und Szenen, die nie existiert haben. Die Qualität hat sich in nur zwei Jahren von erkennbar künstlich zu kaum unterscheidbar von echten Fotos entwickelt.

- Vollständig synthetische Personen: KI erzeugt Fotos und sogar Videos von Menschen, die es in Wirklichkeit gar nicht gibt. Diese werden für Fake-Profile, Propaganda oder Betrug eingesetzt. Webseiten wie „This Person Does Not Exist“ demonstrierten bereits 2019, wie überzeugend diese Fälschungen sein können.

- Video-Generierung: Neuere KI-Modelle wie Sora, Runway oder Kling können ganze Videos aus Textbeschreibungen generieren. Die Qualität steigt rasant und wird in naher Zukunft von echtem Filmmaterial kaum zu unterscheiden sein.

Warum Deepfakes gefährlich sind – reale Schäden durch digitale Fälschungen

Desinformation und Propaganda

Deepfake-Videos von Politikern können Wahlen beeinflussen, Konflikte schüren und das Vertrauen in Medien und Institutionen untergraben. Ein gefälschtes Video eines Staatschefs, der den Krieg erklärt oder eine kontroverse Aussage macht, kann sich viral verbreiten, bevor jemand die Fälschung aufdeckt. Die Plattform klicksafe warnt dabei vor einer besonders perfiden Gefahr: Nicht nur, dass Menschen Fälschungen für echt halten – es entsteht auch das umgekehrte Problem, dass echte Videos als Deepfakes abgetan werden. Jede authentische Aufnahme kann nun angezweifelt werden – eine gefährliche Entwicklung für die Demokratie.

Im Kontext von Kriegen und geopolitischen Konflikten wurden bereits Deepfakes eingesetzt, um falsche Kapitulationsvideos oder erfundene Gräueltaten zu verbreiten. Die Kombination aus emotionalem Inhalt und rascher Verbreitung über Social Media macht solche Fälschungen besonders wirksam.

Betrug und Erpressung

Voice Cloning wird bereits aktiv für Betrugsanrufe genutzt: Kriminelle imitieren die Stimme von Familienmitgliedern und bitten um dringende Geldüberweisungen. Diese Masche wird als „Vishing“ (Voice Phishing) bezeichnet und hat in den letzten Jahren stark zugenommen. In mehreren dokumentierten Fällen wurden Unternehmen um sechsstellige Beträge betrogen, weil Mitarbeiter gefälschte Anrufe ihres Vorgesetzten für echt hielten.

Auch Erpressung mit gefälschten kompromittierenden Bildern nimmt zu. Die Opfer werden mit der Drohung unter Druck gesetzt, die Bilder zu veröffentlichen – obwohl diese vollständig KI-generiert sind. Für die Betroffenen ist die Situation dennoch extrem belastend.

Cybermobbing unter Jugendlichen

Deepfakes werden zunehmend an Schulen und unter Jugendlichen zum Mobbing eingesetzt: Gesichter von Mitschülern werden in peinliche, beleidigende oder sexuelle Kontexte montiert. Die psychischen Folgen können verheerend sein – von Angst und Scham über Depression bis zum sozialen Rückzug. Besonders problematisch: Einmal ins Internet gestellt, lassen sich solche Bilder kaum noch vollständig entfernen.

Mehr zum Thema in unserem Artikel Cybermobbing – was tun?

Nicht-einvernehmliche Pornografie

Ein erschreckend großer Teil aller Deepfakes im Internet ist pornografischer Natur. Studien schätzen den Anteil auf über 90 Prozent aller Deepfake-Videos. Gesichter realer Personen – oft Frauen und zunehmend auch Minderjährige – werden ohne deren Wissen und Einverständnis in explizite Inhalte montiert. Das ist in Österreich strafbar, aber aufgrund der Anonymität des Internets schwer zu verfolgen und für die Betroffenen extrem traumatisch.

Identitätsdiebstahl und Manipulation

Deepfakes ermöglichen eine neue Form des Identitätsdiebstahls: Mit gefälschten Videos oder Fotos können Betrüger sich als andere Personen ausgeben, falsche Online-Profile erstellen oder sogar biometrische Sicherheitssysteme (wie Gesichtserkennung) austricksen. Die Implikationen für die digitale Sicherheit sind enorm.

Wie du Deepfakes erkennst – ein praktischer Leitfaden

Die Erkennung von Deepfakes wird schwieriger, aber es gibt weiterhin Anhaltspunkte, die auf Fälschungen hindeuten können. Die Plattform Saferinternet.at empfiehlt, bei verdächtigen Inhalten immer genau hinzuschauen und kritisch zu hinterfragen.

Deepfake-Erkennung bei Videos

- Unnatürliches Blinzeln: Frühe Deepfakes hatten massive Probleme mit dem Blinzeln – die Person blinzelte zu selten, zu regelmäßig oder gar nicht. Neuere Versionen sind besser, aber bei genauem Hinsehen oft noch nicht perfekt. Achte auf unnatürliche Rhythmen.

- Gesichtsränder und Übergänge: Achte auf die Übergänge zwischen Gesicht und Hintergrund oder Haaren. Unschärfe, Flimmern, leichtes Verwischen oder unnatürliche Ränder können Hinweise sein. Besonders beim Drehen des Kopfes werden diese Artefakte oft sichtbar.

- Beleuchtung und Schatten: Stimmt die Beleuchtung im Gesicht mit der im Rest des Bildes überein? Unterschiedliche Schattenrichtungen, fehlende Reflexionen in den Augen oder unnatürliche Lichtquellen sind verdächtig. Schaue genau auf die Konsistenz der Beleuchtung.

- Mundbewegungen und Lippensynchronisation: Stimmen Lippenbewegungen und Audio exakt überein? Bei Deepfakes gibt es oft minimale Verzögerungen oder die Mundbewegungen passen nicht zu den gesprochenen Lauten. Achte besonders auf Konsonanten wie B, M und P, bei denen sich die Lippen schließen müssen.

- Zähne und Mund: Die Darstellung von Zähnen bereitet KI nach wie vor Schwierigkeiten. Achte auf unnatürlich gleichmäßige Zähne, verschwommene Zahnreihen oder merkwürdige Artefakte im Mundbereich.

- Ohren und Schmuck: Ohren, Ohrringe und Brillen werden von der KI oft fehlerhaft dargestellt. Asymmetrien, die bei echten Aufnahmen nicht vorhanden wären, oder plötzlich verschwindende Accessoires sind starke Hinweise.

- Emotionen und Mimik: Echte menschliche Mimik ist subtil und komplex – Mikroexpressionen, leichte Asymmetrien, natürliche Übergänge zwischen Emotionen. Deepfakes wirken oft „zu gleichmäßig“, zu glatt oder emotionslos. Die Augen wirken manchmal seltsam leer.

- Kopfbewegungen: Schnelle oder ruckartige Kopfbewegungen verursachen bei vielen Deepfakes sichtbare Artefakte. Schaue, ob das Gesicht bei Bewegung „schwimmt“ oder sich unnatürlich vom Hintergrund löst.

Deepfake-Erkennung bei Bildern

- Hände und Finger: KI hat nach wie vor erhebliche Probleme mit Händen – falsche Fingeranzahl, verdrehte Gelenke, zu lange oder zu kurze Finger, verschmolzene Finger. Das ist einer der zuverlässigsten Indikatoren für KI-generierte Bilder, obwohl neuere Modelle auch hier besser werden.

- Text und Schrift: Text in KI-generierten Bildern ist oft unleserlich, unsinnig oder buchstäblich kein echtes Wort. Schilder, Logos und Beschriftungen im Hintergrund sind häufig verzerrt oder ergeben keinen Sinn.

- Hintergründe: Unscharfe oder verwischte Hintergründe mit unlogischen Elementen – Fenster, die in Wände übergehen, Treppen, die ins Nichts führen, Objekte, die physikalisch unmöglich positioniert sind.

- Symmetrie: Zu perfekte Gesichtssymmetrie kann ein Hinweis auf KI-Generierung sein. Echte menschliche Gesichter sind nie perfekt symmetrisch – kleine Abweichungen sind normal und machen ein Gesicht „echt“.

- Haare: Einzelne Haarsträhnen, vor allem am Rand des Kopfes, werden oft unnatürlich dargestellt – sie verschwinden im Hintergrund, sind zu gleichmäßig oder sehen wie gemalt aus.

- Texturen und Hautdetails: Bei genauem Hinsehen können Hautporen, Sommersprossen oder Falten unnatürlich gleichmäßig oder an falschen Stellen erscheinen. Die Hauttextur kann zu glatt oder zu gleichförmig wirken.

- Metadaten: KI-generierte Bilder haben oft keine oder ungewöhnliche Metadaten (EXIF-Daten). Ein Foto ohne Kamera-Informationen, GPS-Daten oder typische Kompressionsmerkmale ist verdächtig.

Deepfake-Erkennung bei Stimmen

- Monotonie und fehlende Nuancen: Geklonte Stimmen klingen oft etwas flacher und weniger emotional als das Original. Subtile Nuancen wie Ironie, Zögern oder emotionale Schwankungen werden nicht immer korrekt wiedergegeben.

- Hintergrundgeräusche: Unnatürliche Stille oder merkwürdige Artefakte im Hintergrund. Echte Telefonate haben fast immer Hintergrundgeräusche – eine komplett stille Leitung kann verdächtig sein.

- Atmung und Pausen: Echte Menschen atmen beim Sprechen, machen natürliche Pausen und haben individuelle Sprechrhythmen. KI-generierte Stimmen vergessen manchmal zu atmen oder klingen zu gleichmäßig.

- Inhalt prüfen: Würde diese Person wirklich das sagen? Klingt der Inhalt plausibel? Werden ungewöhnliche Forderungen gestellt? Im Zweifel: Rufe die Person über eine dir bekannte Nummer zurück oder stelle eine Frage, die nur die echte Person beantworten kann.

Tools und Ressourcen zur Überprüfung

Es gibt verschiedene Tools und Strategien, um verdächtige Inhalte zu überprüfen:

Kostenlose Tools

- Google Rückwärtssuche: Lade ein verdächtiges Bild bei Google Images hoch und prüfe, ob es schon anderswo aufgetaucht ist oder ob es Variationen davon gibt. Oft lässt sich so die Originalquelle finden.

- TinEye: Eine spezialisierte Rückwärts-Bildsuchmaschine, die auch veränderte Versionen eines Bildes findet.

- InVID Verification Plugin: Browser-Erweiterung (für Chrome und Firefox), die speziell für die Verifizierung von Videos und Bildern entwickelt wurde. Sie ermöglicht Bild-Analysen, Metadaten-Prüfungen und Reverse Image Searches direkt im Browser.

- FotoForensics: Analysiert Bilder auf Manipulationsspuren mithilfe von Error Level Analysis (ELA). Bereiche, die nachträglich verändert wurden, zeigen oft ein anderes Fehlerniveau als der Rest des Bildes.

KI-basierte Erkennungstools

- Hive Moderation: KI-basierter Deepfake-Detektor, der Bilder und Videos auf KI-Generierung überprüft.

- SynthID (Google): Digitales Wasserzeichen für KI-generierte Inhalte. Wenn ein Bild mit Google-Tools erstellt wurde, enthält es ein unsichtbares Wasserzeichen, das von SynthID erkannt werden kann.

- AI or Not: Online-Tool, das einschätzt, ob ein Bild von einer KI generiert wurde.

- Content Credentials: Ein branchenübergreifendes System, das die Herkunft und Bearbeitung von Medieninhalten dokumentiert – ähnlich wie ein digitaler Herkunftsnachweis.

Faktencheck-Organisationen

- Mimikama: Österreichische Faktenchecker mit Sitz in Wien, die regelmäßig Deepfakes und Falschinformationen entlarven und aufklären.

- AFP Faktencheck und dpa Faktencheck: Nachrichtenagenturen, die systematisch virale Behauptungen und Bilder überprüfen.

- CORRECTIV: Deutsches gemeinnütziges Recherchezentrum, das unter anderem Faktenchecks durchführt.

Die Psychologie hinter Deepfakes – warum wir darauf hereinfallen

Deepfakes nutzen psychologische Mechanismen aus, die tief in der menschlichen Wahrnehmung verankert sind:

- Confirmation Bias: Wir glauben eher an Inhalte, die unsere bestehenden Überzeugungen bestätigen. Ein Deepfake-Video eines Politikers, den wir ohnehin nicht mögen, werden wir weniger kritisch hinterfragen.

- Seeing is Believing: Über Jahrhunderte galt: Was ich mit eigenen Augen sehe, ist wahr. Dieses Grundvertrauen in visuelle Information macht es schwer, selbst offensichtliche Fälschungen zu hinterfragen.

- Emotionale Reaktion: Deepfakes zielen oft auf starke Emotionen ab – Empörung, Angst, Ekel. Im Zustand emotionaler Erregung ist unsere kritische Urteilsfähigkeit eingeschränkt. Wir teilen Inhalte, bevor wir nachdenken.

- Illusory Truth Effect: Je öfter wir etwas sehen oder hören, desto eher halten wir es für wahr – selbst wenn es anfangs als Fälschung deklariert war.

- Social Proof: Wenn viele Menschen einen Inhalt teilen oder für echt halten, tendieren wir dazu, ihnen zu folgen – auch wenn wir eigentlich Zweifel haben.

Was du aktiv tun kannst – ein Aktionsplan

Sofortmaßnahmen

- Kritisch bleiben: Hinterfrage alles, was zu gut, zu schockierend, zu empörend oder zu perfekt aussieht. Eine gesunde Skepsis ist dein bester Schutz.

- Quellen prüfen: Woher kommt das Video oder Bild? Wer hat es als Erstes geteilt? Gibt es unabhängige Bestätigungen von seriösen Medien? Berichten mehrere Quellen über dasselbe Ereignis?

- Nicht sofort weiterleiten: Wenn du dir nicht sicher bist, ob etwas echt ist, teile es nicht. Die Verbreitung ist ein wesentlicher Bestandteil des Schadens, den Deepfakes anrichten.

- Melden: Deepfakes können auf allen gängigen Plattformen (Instagram, TikTok, YouTube, X/Twitter) gemeldet werden. Nutze die Meldefunktionen aktiv.

- Betroffene unterstützen: Wenn jemand, den du kennst, Opfer eines Deepfakes wird, steh ihnen bei. Zeige Solidarität, hilf beim Melden und verbreite die Fälschung nicht weiter.

Langfristige Strategien

- Medienkompetenz aufbauen: Beschäftige dich regelmäßig mit dem Thema. Folge Faktencheck-Organisationen und informiere dich über neue Entwicklungen in der KI-Technologie.

- Eigene Daten schützen: Je weniger Bild- und Videomaterial von dir öffentlich verfügbar ist, desto schwieriger ist es, Deepfakes von dir zu erstellen. Überprüfe deine Privatsphäre-Einstellungen auf Social Media.

- Andere aufklären: Teile dein Wissen mit Freunden, Familie und Mitschülern. Besonders ältere Verwandte sind oft weniger vertraut mit der Möglichkeit von KI-Fälschungen.

- Vertraue deinem Bauchgefühl: Wenn etwas „irgendwie seltsam“ aussieht oder klingt, hat dein Unterbewusstsein möglicherweise Unstimmigkeiten erkannt, die du noch nicht benennen kannst. Nimm dieses Gefühl ernst und überprüfe den Inhalt.

Mehr zum Thema Fake News und Medienkompetenz in unserem Artikel Fake News erkennen.

Die rechtliche Lage in Österreich

In Österreich gibt es (Stand 2026) kein spezielles „Deepfake-Gesetz“, aber verschiedene bestehende Gesetze greifen bei der missbräuchlichen Verwendung:

- Recht am eigenen Bild (Paragraph 78 UrhG): Das unerlaubte Verwenden von Bildern und Videos einer Person kann gegen das Recht am eigenen Bild verstoßen, wenn berechtigte Interessen verletzt werden. Dies gilt auch für manipulierte Darstellungen.

- Cybermobbing (Paragraph 107c StGB): Fortgesetzte Belästigung im Wege einer Telekommunikation oder eines Computersystems – greift auch bei Deepfakes, die zur Belästigung oder Demütigung eingesetzt werden. Bei Verurteilung drohen bis zu ein Jahr Freiheitsstrafe.

- Pornografie-Gesetze: Das Erstellen und Verbreiten nicht-einvernehmlicher pornografischer Deepfakes ist über verschiedene Paragraphen (u.a. Paragraph 120a StGB – Bildbasierte sexuelle Gewalt) strafbar.

- Betrug (Paragraph 146 StGB): Deepfakes zur Täuschung mit finanziellem Schaden fallen unter den Tatbestand des Betrugs.

- Verleumdung und üble Nachrede (Paragraphen 111, 297 StGB): Deepfakes, die einer Person falsche Aussagen oder Handlungen zuschreiben, können als Verleumdung oder üble Nachrede verfolgt werden.

- DSGVO: Die Verarbeitung von biometrischen Daten (Gesicht, Stimme) für Deepfakes ohne Einwilligung verstößt gegen die Datenschutz-Grundverordnung.

EU-Regulierung: Der AI Act

Die EU hat mit dem AI Act (KI-Verordnung) einen umfassenden Rechtsrahmen für künstliche Intelligenz geschaffen, der auch Deepfakes betrifft. Ab 2026 gelten verschärfte Transparenzpflichten: KI-generierte Inhalte müssen als solche gekennzeichnet werden. Plattformen sind verpflichtet, entsprechende Erkennungssysteme einzusetzen. Das soll es Nutzern ermöglichen, KI-generierte von echten Inhalten zu unterscheiden.

Die Zukunft der Deepfakes – ein Ausblick

Die technologische Entwicklung steht nicht still – und leider wird die Erstellung von Deepfakes immer einfacher und das Ergebnis immer überzeugender:

- Echtzeit-Deepfakes: Bereits heute gibt es Software, die Gesichter in Echtzeit während eines Videoanrufs austauschen kann. Die Qualität wird weiter steigen.

- Demokratisierung der Technologie: Was früher teure Hardware und Spezialkenntnisse erforderte, kann heute mit einem Smartphone und einer App erstellt werden. Die Einstiegshürde sinkt ständig.

- KI gegen KI: Parallel zur Verbesserung der Fälschungstechnologie entwickeln sich auch die Erkennungssysteme weiter. Es ist ein ständiges Wettrüsten zwischen Erstellung und Erkennung.

- Digitale Wasserzeichen und Herkunftsnachweise: Initiativen wie Content Credentials und SynthID arbeiten an Systemen, die die Herkunft jedes digitalen Inhalts nachvollziehbar machen. Das könnte langfristig die wichtigste Verteidigung gegen Deepfakes sein.

- Gesellschaftlicher Wandel: Wir müssen lernen, in einer Welt zu leben, in der visuelle und auditive Medien nicht mehr automatisch als Beweis gelten. Das erfordert ein fundamentales Umdenken in Medienkonsum und Quellenprüfung.

Fazit – vertraue, aber überprüfe immer

Die KI wird immer besser darin, Fälschungen zu erstellen. Deshalb müssen wir immer besser darin werden, sie zu erkennen. Das erfordert ein neues Maß an Medienkompetenz – eine Fähigkeit, die in der Schule, in der Familie und im Alltag geübt werden muss. Es geht nicht darum, allem zu misstrauen oder in Paranoia zu verfallen. Es geht darum, eine gesunde kritische Haltung zu entwickeln und die Werkzeuge zu kennen, mit denen du verdächtige Inhalte überprüfen kannst.

Die gute Nachricht: Je mehr du dich mit dem Thema beschäftigst, desto besser wird dein „Fälschungs-Radar“. Du trainierst dein Auge für Unstimmigkeiten und entwickelst ein Gespür dafür, wann etwas nicht stimmt. Also: Augen auf, Verstand an – und im Zweifel lieber einmal zu viel prüfen als einmal zu wenig. In einer Welt, in der alles gefälscht werden kann, ist kritisches Denken die wertvollste Kompetenz überhaupt.